什么是 CDN 边缘服务器?

边缘服务器是使 Internet 快速发展的主要组成部分。

学习目标

阅读本文后,您将能够:

- 定义 CDN 边缘服务器

- 了解数据如何通过网络传递

- 区分边缘服务器和源站

相关内容

想要继续学习吗?

订阅 TheNET,这是 Cloudflare 每月对互联网上最流行见解的总结!

复制文章链接

什么是 CDN 边缘服务器?

CDN 边缘服务器是位于网络的逻辑极限或“边缘”的计算机。边缘服务器通常充当独立网络之间的连接。CDN 边缘服务器的主要目的是将内容存储在尽可能靠近发出请求的客户端计算机的位置,从而减少延迟并缩短页面加载时间。

边缘服务器是一种边缘设备,可提供进入网络的入口点。其他边缘设备包括路由器和路由交换机。边缘设备通常放置在互联网交换点 (IxP) 以允许不同的网络连接并共享传输。

边缘服务器的工作原理

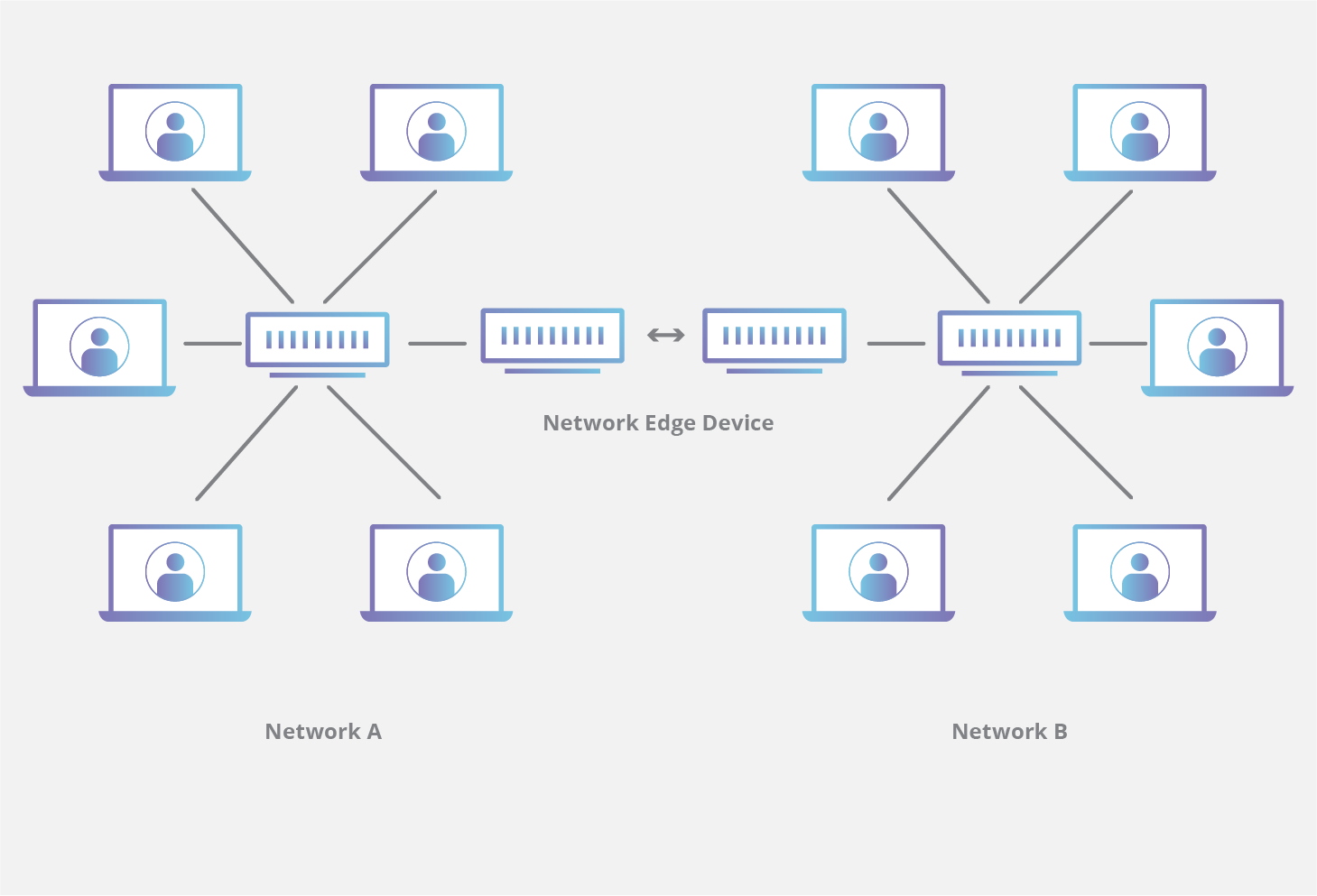

在任何特定的网络布局中,都是多个设备使用一个或多个预定义的网络模式相互连接。如果网络要连接到另一网络或更大的 Internet,则它必须具有某种形式的桥接,以便流量从一个位置流向另一个位置。在网络边缘上创建这种桥接的硬件设备称为边缘设备。

网络跨边缘连接

在有多个设备连接的典型家庭或办公室网络中,移动电话或计算机等的设备通过星型网络模型与网络连接和断开连接。所有设备都存在于同一局域网 (LAN) 中,并且每个设备都连接到中央路由器,它们正是通过中央路由器相互连接的。

要将第二个网络连接到第一个网络,必须在某个点在两个网络之间建立连接。根据定义,边缘设备是网络能够通过其相互连接的设备。

现在,如果网络 A 内的计算机需要连接到网络 B 内的计算机,则该连接必须从网络 A 跨网络边缘传递到第二个网络。同样的范式也可以在更复杂的环境中使用,例如通过 Internet 建立连接时。网络共享传输的能力受到网络之间的边缘设备可用性的限制。

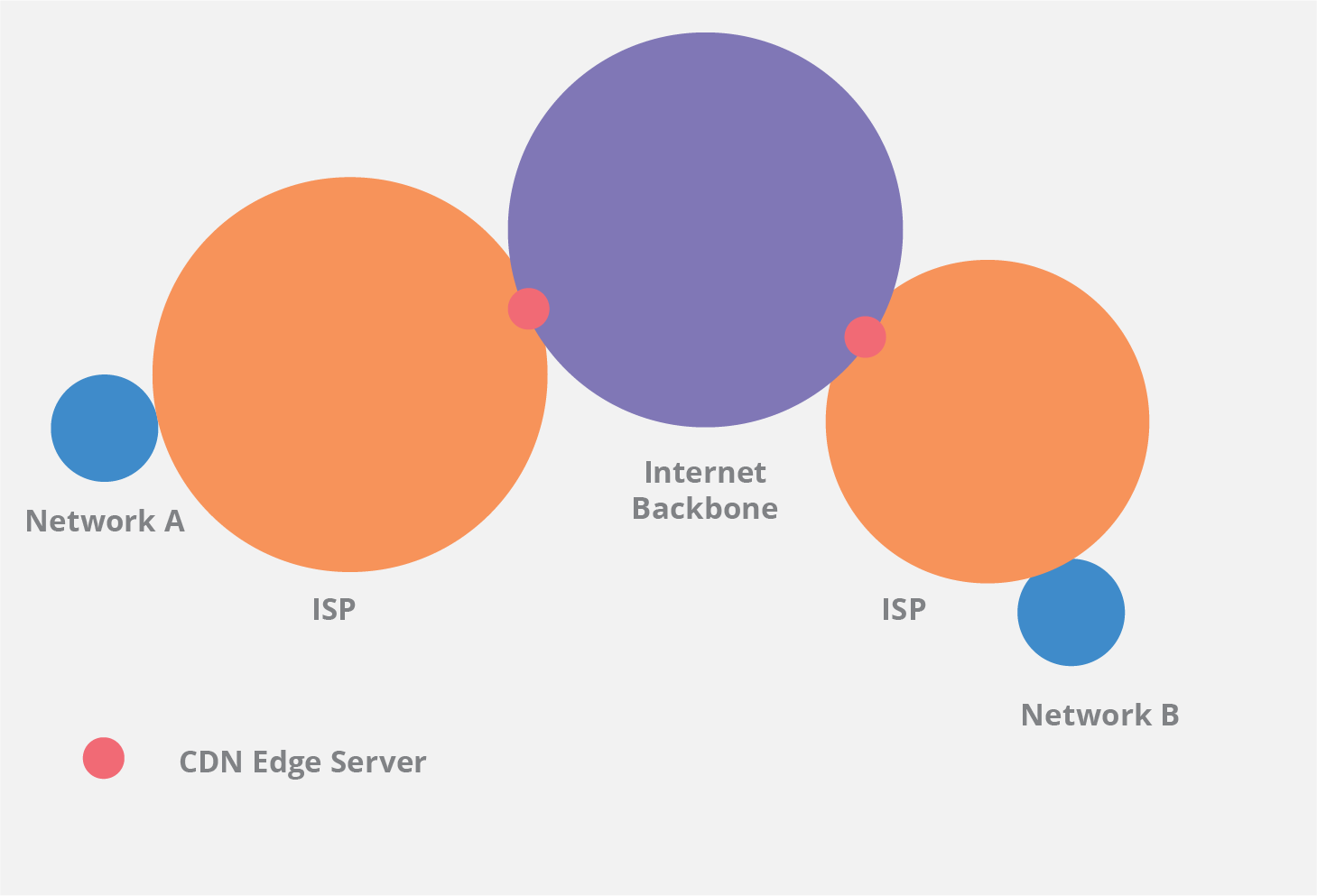

当连接必须穿越互联网时,就必须在网络 A 和网络 B 之间采取更多的中间步骤。为简单起见,我们假设每个网络都是一个圆圈,圆圈相互接触的地方是网络边缘。为了使连接跨互联网移动,它通常会接触许多网络并跨许多网络边缘节点移动。一般来说,连接必须穿越的距离越远,必须遍历的网络数量就越大。在达到目标之前,连接可能会遍历不同的互联网服务提供商和互联网骨干基础设施硬件。

CDN 提供商会将服务器放置在许多位置,但是最重要的是不同网络之间的边缘连接点。这些边缘服务器将与多个的网络连接,允许流量在网络之间快速有效地传递。如果没有 CDN,传输可能会在来源和目的地之间历经较慢和/或较复杂的路线。在最坏的情况下,流量将“延展”出较大距离;当连接到街对面的另一台设备时,连接可能会在全国移动后再返回。通过将边缘服务器放置在关键位置,CDN 可以将内容快速交付给不同网络内的用户。要了解有关使用 CDN 获得的改进的更多信息,请探索 CDN 性能的工作原理。

边缘服务器和源站有什么区别?

源服务器是一种 Web 服务器,当 Web 资产未使用 CDN 时,它接收所有互联网流量。在没有 CDN 时使用源服务器意味着每个互联网请求都必须返回到源服务器的物理位置,而不管它在世界何处。这会导致加载时间延长,服务器距请求客户端计算机越远,加载时间就会越长。

CDN 边缘服务器在具有战略意义的位置存储(缓存)内容,以减轻一个或多个源服务器的负担。通过将静态资产(如图像、HTML 和 JavaScript 文件以及可能的其他内容)尽可能移到请求客户端计算机附近,边缘服务器缓存可以减少加载 Web 资源所需的时间。使用 CDN 时,源服务器仍具有重要的功能,因为重要的服务器端代码(例如用于身份验证的哈希客户端凭据数据库)通常在原始位置维护。了解 Cloudflare CDN 和遍布全球的边缘服务器。

常见问题解答

What defines an edge server in the context of a CDN?

An edge server is a device located at the network's logical extreme, or edge; such a server reduces latency by processing requests as close to the end user as possible. Within a content delivery network (CDN), these servers serve as the primary connection point between a visitor and the origin server.

How does an edge server improve website performance?

By sitting between a user and an origin server, an edge server minimizes the physical distance data must travel. This reduced distance decreases the time it takes for a website to load, providing a faster and more responsive experience for the user.

边缘服务器和源站有什么区别?

An origin server is the central source where a website's original data and content reside. An edge server is part of a distributed network that stores cached versions of that data in multiple global locations to ensure faster delivery to nearby users.

In what ways does an edge server provide security for a website?

Edge servers may act as a protective barrier at the network's perimeter. They can be equipped with security tools like a web application firewall (WAF) or DDoS mitigation services to identify and block malicious traffic before it can reach the origin server.

What happens when a user requests content that is not cached by the CDN?

If the requested content is not already stored on the edge server, the server forwards the request to the origin server. Once it receives the data, the edge server delivers it to the user and can then cache it to fulfill future requests from other nearby users more quickly.

Why are edge servers often located in Internet exchange points (IXPs)?

Placing edge servers in IXPs allows them to connect directly with different Internet service providers (ISPs). This strategic placement reduces the number of hops or network transitions required to deliver content, further reducing latency.

How do edge servers contribute to the scalability of a website?

CDN edge servers help a website scale by offloading a significant amount of traffic from the origin server. By handling the majority of requests locally, the edge servers prevent the origin server from becoming overwhelmed during periods of high traffic or sudden surges.